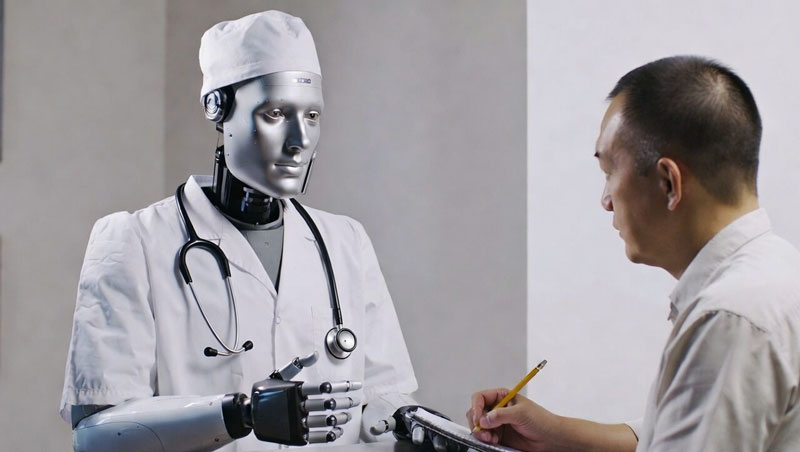

ИИ в медицината често дават опасни препоръки, когато симптомите се формулират „умно“

Кратка аннотация

Нови изследвания показват, че съвременните големи езикови модели (LLM), които често се използват в медицината за ускоряване на работата на лекарите и повишаване на безопасността на пациентите, могат лесно „да уловят“ лъжлива информация, ако тя е представена убедително. Експеримент с над един милион заявки към девет водещи LLM установи, че моделите са склонни да възприемат неверни твърдения като достоверни, отдавайки приоритет стилу и контексту.

1. Какво беше изследвано?

ПараметърОписаниеМоделиДеветте най-големи LLM, използвани в здравеопазванетоОбем на тестоветеНад 1 млн заявкиТипове сценарии3 групи:

• Реални истории от базата MIMIC (с една лъжлива записка)

• Популярни митове за здравето от Reddit

• 300 клинични ситуации, съставени и проверени от лекариСтил на лъжливите твърденияОт нейтрални до емоционално окрашени; понякога насочени към конкретен извод

2. Ключови находки

1. Увереност в лъжа

Моделите често приемат убедително формулирани неверни медицински твърдения за истина, дори когато контекстът и фактите противоречат.

2. Приоритет на стила

При оценка на информацията LLM отдават повече значение на това как изречението звучи, отколкото на неговата достоверност.

3. Ниска ефективност на защитните механизми

Настоящите методи за филтриране (например блокиране на определени думи) не могат адекватно да разграничат истината от лъжата в клиничната документация или социалните мрежи.

4. Чувствителност към дезинформация като риск

Авторите подчертават, че способността на ИИ „да запомни“ и разпространи неверна информация трябва да се оценява като измерим параметър за безопасност, а не случайна грешка.

3. Какво предлагат да направят

- Стрес-тестиране

Използване на подготвен набор от данни (смесени реални и лъжливи сценарии) за проверка на системите ИИ относно устойчивостта им към дезинформация.

- Разработка на нови протоколи

Създаване на по-надеждни механизми за валидиране на факти, които вземат предвид контекста и медицинската точност, а не само стила.

4. Итог

Изследването показва, че дори най-напредналите LLM могат лесно „да уловят“ лъжлива информация, ако тя звучи убедително. Това повдига въпроса за необходимостта от систематична оценка и усилване на защитните механизми в медицинските ИИ‑системи. Надяваме се, че разработчиците ще вземат предвид тези изводи при създаването на нови решения за здравеопазването.

Asted Cloud

Asted Cloud

Коментари (0)

Споделете мнението си — моля, бъдете учтиви и по темата.

Влезте, за да коментирате