Nvidia обяви чип Groq 3 LPU, който ускорява инференса на модели за изкуствен интелект до ниво токени.

НVIDIA разкрива нови възможности на платформата Vera Rubin

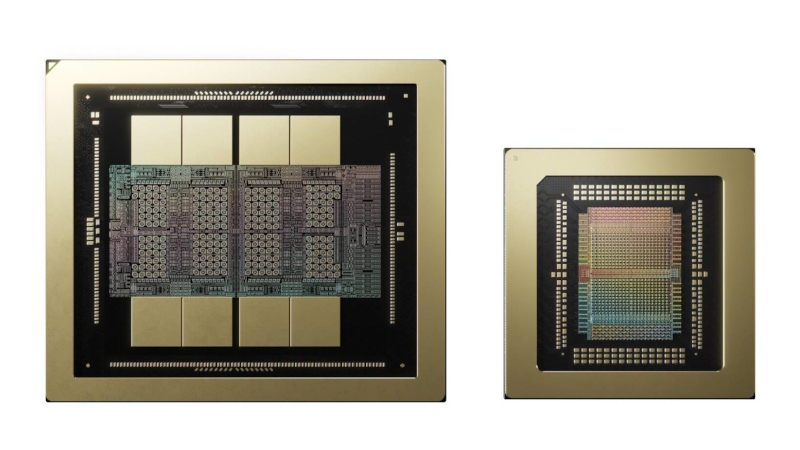

На конференцията GTC тази година главният изпълнителен директор на NVIDIA Дженсен Хуанг обяви разширяване на платформата Vera Rubin. Основата на новите възможности е интелектуалната собственост, придобита от компанията Groq, и в Rubin се включва чипът *Groq 3 LPU* – ускорител за инференс, предназначен за издаване на токени с висока скорост и ниска закъснение.

Какво вече има във Vera Rubin

Платформата се състои от шест ключови компонента, които NVIDIA събира в стойки и скалира до големи AI‑фабрики:

КомпонентОписаниеGPU RubinВидеокарта с 288 GB HBM4CPU VeraЦентрален процесорNVLink 6Система за вътрешно-масштабиранеConnectX‑9Интелигентен мрежов адаптерBlueField‑4Процесор за обработка на данниSpectrum‑XКомутатор за междосистемно мащабиране с интегрирана оптика

Groq 3 LPU вече е добавен като нов строителен блок, който ще се използва при разгръщане на големи системи.

Защо Groq 3 LPU се отличава

Главната разлика – архитектурата на паметта. Докато повечето ускорители използват HBM като работна памет, всеки Groq 3 LPU съдържа 500 MB SRAM. Сравнение:

ПараметърGPU Rubin (HBM4)Groq 3 LPU (SRAM)Емплостност288 GB0,5 GBПропускна способност~22 TB/sдо 150 TB/s

За задачи за инференс, чувствителни към пропускната способност, предимството на SRAM е очевидно. Именно затова NVIDIA включи Groq 3 в Rubin – за да повиши скоростта на издаване на токени.

Стойка Groq 3 LPX

В стойката има 256 чипа Groq 3 LPU, което осигурява:

- 128 GB SRAM

- 40 PB/s обща пропускна способност

- 640 TB/s вътрешно-мрежов интерфейс

Vice‑President за хипермасштабируеми решения Иън Бак нарече тази стойка сопроцесор за Rubin, подчертавайки нейната роля в повишаване на производителността при декодиране на всеки слой от модела и токен.

Влияние върху мултиагентни системи

Бак отбеляза, че Groq 3 LPX ще бъде ключов елемент за бъдещия AI‑пазар – мултиагентните системи. Когато агентите обменят данни директно, а не чрез чат‑ботове, изискванията към отклика се променят: от 100 токена/с до над 1 500+ токени/с и повече.

Конкуренти и перспективи

В текста е споменат конкурент – Cerebras, използваща Wafer‑Scale Engine (WSE) с огромен SRAM за инференс с ниска латентност. OpenAI вече задействала Cerebras в своите напреднали модели благодарение на предимната закъснение.

Бак също отбеляза, че появата на Groq 3 LPU може да намали зависимостта от ускорителя Rubin CPX. Докато NVIDIA се фокусира върху интегрирането на стойката Groq 3 LPX с платформата, двата чипа са предназначени за усилване на инференс без необходимост от големи обеми GDDR7 памет.

Резултат:

Новият чип Groq 3 LPU и неговата стойка LPX засилват Vera Rubin в сегмента с ниска латентност, отваряйки път към по-бързи мултиагентни AI‑системи и конкурирайки се с играчи като Cerebras.

Asted Cloud

Asted Cloud

Коментари (0)

Споделете мнението си — моля, бъдете учтиви и по темата.

Влезте, за да коментирате